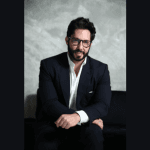

O avanço da inteligência artificial (IA) tem provocado profundas transformações em diversos setores, inclusive no universo jurídico. À medida que algoritmos passam a desempenhar funções decisivas — de análise de dados a sugestões de decisões judiciais —, surge um questionamento inevitável: até onde vai a responsabilidade jurídica por atos praticados por sistemas autônomos? Segundo o advogado Dr. Aroldo Fernandes da Luz, essa é uma das discussões mais complexas e urgentes do nosso tempo, exigindo uma abordagem interdisciplinar e prudente.

A atuação crescente da IA no campo jurídico

Hoje, sistemas de inteligência artificial já são utilizados para automatizar petições iniciais, classificar processos, auxiliar na jurisprudência e até indicar probabilidades de êxito em ações judiciais. Tribunais, escritórios de advocacia e órgãos públicos vêm adotando essas ferramentas para acelerar procedimentos e reduzir custos operacionais.

De acordo com Dr. Aroldo Fernandes da Luz, embora a IA seja uma aliada poderosa, é necessário reconhecer seus limites. A tomada de decisão jurídica envolve não apenas lógica, mas interpretação, contexto, valores e ética — elementos que ainda estão fora do alcance dos algoritmos.

Quem responde por erros cometidos por uma IA?

A grande dúvida que paira sobre o uso da inteligência artificial é: quem responde juridicamente se uma decisão baseada em IA causar danos? Em casos em que um sistema automatizado falha ao negar um benefício previdenciário, indicar uma sentença equivocada ou impactar negativamente um cidadão, a responsabilidade recai sobre quem?

Conforme aponta Dr. Aroldo Fernandes da Luz, a resposta ainda está em construção. A princípio, aplica-se o princípio da responsabilidade objetiva do Estado ou da empresa desenvolvedora, a depender do caso. Contudo, a ausência de uma legislação específica para tratar de responsabilidades decorrentes da atuação de inteligências artificiais cria uma lacuna perigosa, que pode comprometer direitos fundamentais.

A responsabilidade do programador, do usuário e do Estado

A responsabilidade no uso da IA pode ser compartilhada entre diferentes agentes:

- O programador, por eventuais falhas de desenvolvimento, viéses algorítmicos ou omissões relevantes no código;

- O usuário, como advogados, juízes ou empresas, que tomam decisões com base nas sugestões da IA sem o devido cuidado;

- O Estado, quando utiliza sistemas automatizados em serviços públicos que afetam diretamente a vida do cidadão.

Segundo Dr. Aroldo Fernandes da Luz, nenhum sistema de inteligência artificial deve funcionar de forma completamente autônoma em áreas sensíveis do Direito sem supervisão humana qualificada. A responsabilização precisa levar em conta essa cadeia de decisões e garantir mecanismos de controle, transparência e revisão.

A regulação da IA no Brasil e no mundo

Diversos países já estão debatendo marcos regulatórios específicos para o uso da inteligência artificial. A União Europeia, por exemplo, tem avançado em propostas que classificam os riscos da IA e estabelecem obrigações legais para cada tipo de aplicação. No Brasil, o Projeto de Lei 2338/2023, que institui o Marco Legal da Inteligência Artificial, é um passo importante nessa direção, embora ainda careça de aprofundamentos técnicos e jurídicos.

Dr. Aroldo Fernandes da Luz defende que o ordenamento jurídico brasileiro precisa acompanhar esse debate de forma proativa, promovendo segurança jurídica tanto para desenvolvedores quanto para usuários, sem abrir mão da proteção aos direitos fundamentais.

Os limites éticos da atuação da IA no Direito

Mais do que responsabilidade legal, a IA no campo jurídico exige responsabilidade ética. A imparcialidade dos sistemas, o respeito à privacidade de dados, a explicabilidade das decisões e a não discriminação são princípios que devem nortear qualquer uso de tecnologia no Direito.

Como lembra Dr. Aroldo Fernandes da Luz, o risco não está apenas na falha técnica, mas na naturalização de decisões frias e descontextualizadas, que ignoram as complexidades humanas. A tecnologia deve servir ao Direito — e não o contrário.

Conclusão: inteligência com responsabilidade

A presença da inteligência artificial no Direito é irreversível. Cabe aos operadores jurídicos, legisladores, desenvolvedores e à sociedade como um todo construir um ambiente regulatório que permita inovação sem abrir mão da justiça, da ética e da responsabilidade.

Segundo Dr. Aroldo Fernandes da Luz, a tecnologia é uma ferramenta poderosa, mas é o ser humano quem deve conduzi-la com discernimento. A responsabilidade no uso da IA é compartilhada, e sua gestão exige não apenas normas técnicas, mas um compromisso real com os valores que sustentam o Estado de Direito.

Autor: Mikesh Sarsana